Apuntes para el desarrollo de la arquitectura de organizaciones basadas

en Agentes de Inteligencia artificial bajo custodia humana del sentido.

Arq. MBA. Eleodoro Ventocilla Cuadros

Resumen

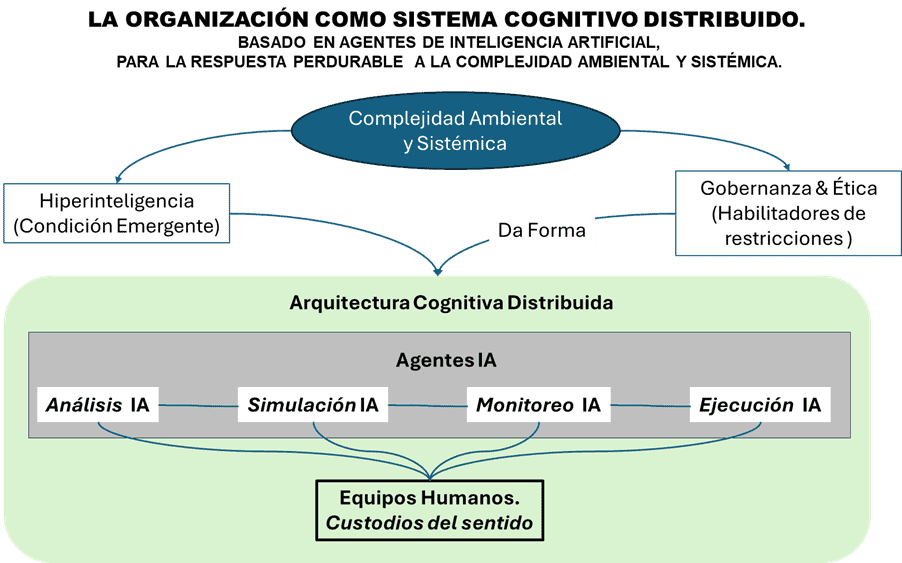

Las organizaciones contemporáneas enfrentan un contexto caracterizado por aceleración exponencial, hiper conectividad y complejidad sistémica. Los modelos organizacionales tradicionales, diseñados bajo supuestos de estabilidad y control jerárquico, muestran crecientes limitaciones para operar en entornos dinámicos e inciertos (Anderson, 1999; Brown & Eisenhardt, 1997; Uotila & Morrell, 2025).

Este artículo propone un marco conceptual para el tránsito de las organizaciones tradicionales a organizaciones basadas en Agentes de Inteligencia Artificial (AIA), situadas en la condición emergente de la Hiperinteligencia y en el tránsito conceptual denominado El Umbral por el autor (Ventocilla Cuadros, 2025, 2026).

“El principal aporte del artículo es conceptualizar a los Agentes de Inteligencia Artificial como actores organizacionales, proponiendo una arquitectura cognitiva que reconfigura gobernanza, roles humanos y capacidad evolutiva.”

Se argumenta que dicha transformación no constituye una simple adopción tecnológica, sino una reconfiguración profunda de la arquitectura cognitiva, la gobernanza y el rol humano en la organización (Hutchins, 1995; Batool et al., 2025; Floridi et al., 2018).

Finalmente, se presenta una ruta crítica de desarrollo organizacional, entendida como proceso evolutivo orientado a la perdurabilidad.

Palabras clave: Hiper Inteligencia, Agentes de Inteligencia Artificial, Transformación Organizacional, Complejidad, Gobernanza, El Umbral.

1. Introducción: el agotamiento del modelo organizacional tradicional

Las organizaciones que dominan el paisaje institucional actual —empresas, organismos públicos y organizaciones sociales— no están fallando en términos operativos; funcionan de acuerdo con los principios para los cuales fueron diseñadas. El problema radica en que dichos principios responden a un mundo que ha dejado de existir.

Desde la teoría de la complejidad aplicada a las organizaciones, se reconoce que los sistemas organizacionales exhiben comportamientos no lineales y patrones emergentes difíciles de gobernar mediante control centralizado (Anderson, 1999). En entornos de alta velocidad, la capacidad de sostener cambio continuo suele requerir equilibrios entre estructura y flexibilidad —“semiestructuras”— y mecanismos que enlacen presente y futuro en ciclos rítmicos de transición (Brown & Eisenhardt, 1997).

En esta perspectiva, la crisis que enfrentan las organizaciones no es principalmente de eficiencia, sino de inteligencia organizacional: de su habilidad para percibir, interpretar, anticipar y actuar en condiciones de complejidad.

Este escenario marca el cruce de El Umbral: un punto de no retorno donde el pasado ya no explica el futuro y se vuelve imprescindible diseñar nuevas formas de organización capaces de aprender, adaptarse y evolucionar (Ventocilla Cuadros, 2025).

2. Hiper Inteligencia como nueva condición sistémica.

La Hiper Inteligencia no puede entenderse como una mera intensificación de la inteligencia artificial; se describe más adecuadamente como una condición sistémica emergente producto de la integración dinámica de múltiples inteligencias: humana, artificial, colectiva y distribuida en redes socio‑técnicas (Ventocilla Cuadros, 2025).

Una visión compatible proviene de la noción de cognición distribuida, según la cual procesos cognitivos relevantes no se localizan únicamente en individuos, sino que se distribuyen entre personas, artefactos y prácticas situadas (Hutchins, 1995).

En escenarios contemporáneos, tecnologías avanzadas (incluyendo IA) amplifican el “offloading” (descarga) cognitivo y reconfiguran el reparto de tareas mentales entre agentes humanos y soportes técnicos, con beneficios de desempeño y riesgos sobre habilidades y dependencia (Grinschgl & Neubauer, 2022).

Asimismo, trabajos recientes subrayan que, aun con IA en entornos organizacionales, la inteligencia se expresa como capacidad colectiva y culturalmente mediada, no como atributo exclusivo de personas o de máquinas (Pasquinelli et al., 2024).

En sistemas hiperinteligentes, la organización deja de ser una estructura mecánica para comportarse como un sistema cognitivo complejo. Esta transición es consistente con enfoques de diseño organizacional que señalan la necesidad de estrategias específicas para operar en mundos complejos e inestables (Meissner et al., 2024; Uotila & Morrell, 2025).

“Si la Hiper Inteligencia describe la nueva condición sistémica, los Agentes de IA constituyen su materialización operativa dentro de las organizaciones.”

3. Agentes de Inteligencia Artificial como actores organizacionales

En el marco de esta condición emergente, los Agentes de Inteligencia Artificial (AIA) representan un quiebre respecto de la concepción tradicional de la tecnología como herramienta pasiva. En la literatura clásica de agentes y sistemas multiagente, un agente se entiende como una entidad autónoma capaz de percibir su entorno y actuar en función de objetivos, en interacción con otros agentes y restricciones del medio (Wooldridge, 2009).

Desde la tradición de IA, la noción de “agente inteligente” también se define por su capacidad de seleccionar acciones según percepciones y medidas de desempeño, incluyendo escenarios multiagente (Russell & Norvig, 2021).

La incorporación de AIA implica que la inteligencia deja de estar concentrada exclusivamente en las personas. Los AIA se convierten en actores cognitivos organizacionales, participando en procesos de análisis, decisión y acción, lo que redistribuye la inteligencia dentro del sistema organizacional.

Esta redistribución es consistente con hallazgos sobre automatización como cognición distribuida en organizaciones de trabajo del conocimiento, donde se vuelve crítica la asignación de tareas humano‑automatización y la gestión del conocimiento colectivo para mitigar descalificación (Asatiani et al., 2019).

4. De la jerarquía al sistema cognitivo distribuido

Las organizaciones tradicionales se estructuran en torno a jerarquías, control y centralización de decisiones. Sin embargo, estos mecanismos no escalan adecuadamente en contextos de alta complejidad.

La teoría de complejidad organizacional sostiene que la dirección estratégica en sistemas complejos se aproxima mejor como configuración de condiciones y “paisajes de aptitud” donde soluciones autoorganizadas pueden emerger (Anderson, 1999).

En contraste, las organizaciones basadas en agentes operan como redes cognitivas distribuidas, donde múltiples agentes especializados interactúan entre sí y con las personas. La coordinación se logra mediante orquestación, no mediante control.

Este enfoque dialoga con la idea de cambio continuo: sostener adaptación exige estructuras mínimas que habiliten improvisación, exploración mediante “pruebas” de bajo costo hacia el futuro y transiciones rítmicas entre ciclos (Brown & Eisenhardt, 1997).

5. El nuevo rol humano: custodios del sentido

La transformación hacia organizaciones hiperinteligentes redefine profundamente el rol humano. A medida que agentes asumen funciones de cálculo, simulación, optimización y ejecución, las personas se desplazan hacia funciones de mayor nivel cognitivo y ético.

Desde cognición distribuida, separar “lo cognitivo” de “lo social” es insuficiente: los equipos y sus artefactos conforman sistemas cognitivos ampliados, y el aprendizaje se entiende como cambio en la organización de esos sistemas (Hutchins, 1995).

En este contexto, el aporte humano se concentra en el diseño de criterios, valores, sentido y propósito, dimensiones críticas para orientar sistemas que optimizan medios, pero no determinan fines.

El énfasis en la dimensión cultural y colectiva del trabajo con IA refuerza que la adopción de IA no es meramente técnica, sino profundamente organizacional y social (Pasquinelli et al., 2024).

6. Gobernanza y ética en organizaciones basadas en agentes

La introducción de agentes de IA en procesos críticos exige una reconsideración profunda de la gobernanza. En sistemas donde decisiones son parcialmente automatizadas, la confianza no puede ser implícita: debe ser diseñada.

En el campo de ética de IA, se propone que una “buena sociedad” con IA requiere principios y recomendaciones explícitas que orienten desarrollo y adopción responsable (Floridi et al., 2018).

En paralelo, una revisión sistemática reciente sobre gobernanza de IA destaca desafíos sobre quién es responsable, qué se gobierna, cuándo ocurre la gobernanza en el ciclo de vida y cómo se implementa mediante marcos, políticas y herramientas (Batool et al., 2025).

En el caso específico de agentes, la gobernanza adquiere mayor urgencia debido a que los agentes no solo “producen salidas”, sino que pueden ejecutar acciones y operar con autoridad delegada. Por ello, se recomiendan prácticas organizacionales para incorporar clasificación, evaluación y supervisión estructurada de agentes, análogas a un “onboarding” (incorporación) riguroso y progresivo (World Economic Forum, 2025).

A nivel de guías operativas, se destaca la necesidad de controles de gobernanza y seguridad para agentes: gobierno de datos, observabilidad, seguridad y prácticas de desarrollo a lo largo del ciclo de vida (Microsoft Learn, 2025).

7. Ruta crítica para la transformación hacia organizaciones basadas en Agentes de IA

La transición desde una organización tradicional hacia una organización basada en Agentes de IA no es un evento puntual, sino un proceso evolutivo. Esta premisa se alinea con la literatura de cambio continuo, que enfatiza capacidades sostenidas de adaptación y exploración, más que transformaciones episódicas (Brown & Eisenhardt, 1997).

Además, en entornos complejos, la dirección efectiva se aproxima como diseño de condiciones que habiliten soluciones emergentes y aprendizaje, en lugar de control total (Anderson, 1999).

A partir del marco conceptual del presente trabajo, se propone la siguiente ruta crítica de cinco fases interdependientes:

7.1 Conciencia del agotamiento del modelo heredado.

La transformación inicia con el reconocimiento explícito de los límites de modelos jerárquicos, centralizados y rígidos frente a la complejidad contemporánea. Sin esta conciencia, la adopción tecnológica tiende a convertirse en maquillaje digital.

Este diagnóstico se refuerza desde enfoques de complejidad que subrayan la insuficiencia de respuestas lineales en sistemas no lineales (Uotila & Morrell, 2025).

7.2 Exploración controlada mediante agentes

En una segunda fase, los AIA se introducen experimentalmente en dominios acotados (p. ej., análisis, monitoreo, simulación) para aprender sin comprometer estabilidad.

La lógica de “pruebas”, prototipos o experimentos de bajo costo para explorar futuros posibles ha sido señalada como rasgo de organizaciones exitosas en ambientes de alta velocidad. (Brown & Eisenhardt, 1997).

7.3 Integración de agentes, datos y personas

Superada la etapa experimental, los agentes se integran en redes más amplias, interactuando entre sí y con equipos humanos; aquí emerge la inteligencia colectiva aumentada.

Este punto exige atención a dinámicas de cognición distribuida y coordinación humano‑IA, incluyendo riesgos de sobrecarga cognitiva y pérdida de conciencia situacional en ciertos contextos. (Jacobsen et al., 2025).

7.4 Rediseño organizacional profundo

La integración sostenida hace inevitable rediseñar estructuras, roles, procesos y gobernanza. La organización comienza a operar como sistema cognitivo distribuido.

En términos de complejidad, esto implica reconfigurar arquitectura organizacional para habilitar adaptación y aprendizaje continuo. (Meissner et al., 2024).

7.5 Evolución continua como principio organizacional

Finalmente, la organización adopta aprendizaje permanente como principio estructural: la transformación deja de ser proyecto y se convierte en capacidad evolutiva.

La gobernanza debe acompañar esta evolución mediante mecanismos sostenidos de evaluación, supervisión y control de riesgos en el ciclo de vida de IA. (Batool et al., 2025; Microsoft Learn, 2025).

8. Conclusiones: una decisión civilizatoria

Avanzar a una organización basada en Agentes de IA no es una decisión tecnológica; es una decisión que redefine cómo se crea valor, cómo se toman decisiones y qué futuros se consideran posibles.

En sociedades mediadas por sistemas inteligentes, la ética y la gobernanza constituyen condiciones habilitantes para construir confianza y legitimidad (Floridi et al., 2018; Batool et al., 2025).

Las organizaciones que logren integrar Hiper Inteligencia, agentes, valores humanos y propósito no solo estarán mejor preparadas para sobrevivir en entornos inciertos, sino que desarrollarán la capacidad de perdurar cruzando sucesivos umbrales de cambio sin colapsar (Ventocilla Cuadros, 2025, 2025).

Referencias

Anderson, P. (1999). Perspective: Complexity theory and organization science. Organization Science, 10(3), 216–232. https://doi.org/10.1287/orsc.10.3.216

Asatiani, A., Rinta‑Kahila, T., Penttinen, E., & Salovaara, A. (2019). Implementation of automation as distributed cognition in knowledge work organizations: Six recommendations for managers (Conference paper). ICIS.

Batool, A., Zowghi, D., & Bano, M. (2025). AI governance: A systematic literature review. AI and Ethics, 5, 3265–3279. https://doi.org/10.1007/s43681-024-00653-w

Brown, S. L., & Eisenhardt, K. M. (1997). The art of continuous change: Linking complexity theory and time-paced evolution in relentlessly shifting organizations. Administrative Science Quarterly, 42(1), 1–34. https://doi.org/10.2307/2393807

Floridi, L., Cowls, J., Beltrametti, M., Chatila, R., Chazerand, P., Dignum, V., … Vayena, E. (2018). AI4 People—An ethical framework for a good AI society: Opportunities, risks, principles, and recommendations. Minds and Machines, 28, 689–707. https://doi.org/10.1007/s11023-018-9482-5

Grinschgl, S., & Neubauer, A. C. (2022). Supporting cognition with modern technology: Distributed cognition today and in an AI-enhanced future. Frontiers in Artificial Intelligence, 5, Article 908261. https://doi.org/10.3389/frai.2022.908261

Hutchins, E. (1995). Cognition in the wild. MIT Press. https://doi.org/10.7551/mitpress/1881.001.0001

Jacobsen, R. M., Wester, J., Djernæs, H. B., & van Berkel, N. (2025). Distributed cognition for AI-supported remote operations: Challenges and research directions. arXiv. https://doi.org/10.48550/arXiv.2504.14996

Meissner, J. O., Heike, M., & Sigrist, D. (2024). Organization and complexity. In Organizational design in a complex and unstable world (pp. 11–32). Springer. https://link.springer.com/chapter/10.1007/978-3-658-45022-9_2

Microsoft Learn. (2025, December 5). Governance and security for AI agents across the organization. https://learn.microsoft.com/en-us/azure/cloud-adoption-framework/ai-agents/governance-security-across-organization

Pasquinelli, M., Alaimo, C., & Gandini, A. (2024). AI at work: Automation, distributed cognition, and cultural embeddedness. Tecnoscienza, 15(1), 99–131. https://doi.org/10.6092/issn.2038-3460/20010

Russell, S. J., & Norvig, P. (2021). Artificial intelligence: A modern approach (4th ed.). Pearson.

Uotila, J., & Morrell, K. (2025). Complexity as a domain between order and chaos: Implications for organizational scholarship. Organization Studies (preprint). https://wrap.warwick.ac.uk/191849

Ventocilla Cuadros, E. (2025). El Umbral: Arquitectura de futuros, capacidades y competencias para el tránsito a la sociedad cuántica

Ventocilla Cuadros, E. (2026). La Humanidad Aumentada. El camino sin mapas a la Hiperinteligencia

Wooldridge, M. (2009). An introduction to multiagent systems (2nd ed.). Wiley.World Economic Forum. (2025, December 2). Using AI agents in organizations today and in the future: How to build a strong foundation for AI agent evaluation and governance. https://www.weforum.org/stories/2025/12/ai-agents-onboarding-governance/